Исследуем в данной книге системы, немыслимые в том отношении, что они слишком велики для анализа. Как только что было показано, наша планета — слишком малый компьютер для оценки всего разнообразия состояний даже относительно небольшой системы. Однако в природе полным-полно систем не меньшей сложности и активности, но природа живёт и действует. Так же, как лучшая географическая карта страны — сама страна, так и лучший компьютер естественных систем — сама такая система. Представьте себе море — оно уравновешено. Проходят приливы и бури, вся вода поднимается дыбом. Можно ли себе представить математическую программу для компьютера с релевантным входом для всех этих ситуаций, который бы подсчитал, что получится на выходе как функция волнения на море? Задача безнадёжной сложности. Но ответ есть — волны, течение, воронки и брызги. Посмотрим на биосферу — тонкую оболочку жизни, покрывающую нашу землю (или геосферу). От микроба до слона — здесь взаимодействуют все формы живого. В частности, они кормят друг друга. Мы, люди, не можем потреблять столько растительной пищи, чтобы поддерживать наши физиологические нужды, — слишком мал для этого наш химзавод по производству белка. И тогда мы поедаем животных, используя их как продукт питания. Но как велико разнообразие живого? Как поддерживается численность живого, чтобы хватило всем членам данной системы? Частичный ответ в самом разнообразии. Было подсчитано, что единственная пара растительной тли — капустный aphis, весящая 1 мг, при неограниченном питании и без помех её размножению даст Всё дело в том, что экологическая система — система самоорганизующаяся. Она сама — огромная счётная машина, дающая правильные ответы (или почти правильные, если учесть эпидемии, голод, другие бедствия). Но у неё нет программы, планового отдела, разрешения на размножение, бюрократии. Она только работает. Мы, разумные люди, вмешиваемся в эту систему, нарушаем её равновесие в собственных интересах. Так, например, мы увеличиваем урожайность или продуктивность скота. Мы обращаемся с ней на «нижнем уровне» её жизни, как боги, стоящие над системой, забывая о том, что мы сами часть её целого. В результате мы можем весьма эффективно управлять плодородием, размножением Pasteurella pestis — бациллами, которые вызывают бубонную чуму, но не управляем ростом собственного вида — Homo sapiens. Мы видим, что наши коровы сыты, но не наши братья — почти половина человечества. По-видимому, в естественных системах есть способность к самоорганизации, есть тот огромный «разум», действующий методами, которых мы до сих пор толком не понимаем. Можно считать, что природные системы не оптимальны в математическом смысле. И дело тут не в мощности счета, поскольку нельзя считать с такой скоростью, чтобы оценить все возможные результаты и выбрать «наилучший» вариант исходя из Здесь мы должны ввести два термина и дать их определение, чтобы разобраться в только что поднятой проблеме. Первый из них — алгоритм. Алгоритм — это метод (или механизм), который предписывает, каким образом достичь поставленной цели. Типичный план полёта самолёта — это алгоритм. Инструкция: «Повернуть на перекрёстке налево, повернуть направо на следующем, выехать на улицу Красного льва и мой дом будет в 120 метрах справа» — тоже алгоритм. Метод извлечения квадратного корня — тоже алгоритм, как и программа работы ЭВМ. Последнее очень важно, поскольку нам предстоит разобраться в некоторой путанице относительно возможностей компьютера. Компьютер может делать лишь то, что ему точно указано. Программист, следовательно, должен точно написать алгоритм, который бы точно определил работу компьютера в наборе имеющихся в нём данных и команд. Другой термин, который нам понадобится, — эвристический. Это не столь часто употребляемое имя прилагательное означает «обеспечивающий открытие», нередко превращается в имя существительное при переходе от эвристического метода к «эвристике». Эвристика определяет метод поведения, помогающий достижению цели, но который не может быть чётко охарактеризован, поскольку мы знаем, чего хотим, но не знаем, как этого достичь, где лежит решение. Предположим, Вы хотите достичь конусообразной вершины горы, закрытой облаками. У неё есть высшая точка, но у Вас нет точного маршрута. Указание «продолжайте подъём» приведёт Вас к вершине, где бы она ни была. Это эвристика. «Смотри за пенсами, а фунты сами о себе позаботятся» — эвристическое указание «как стать богатым». Эвристика предписывает общие правила для достижения общих целей Эти два термина — весьма важные понятия в кибернетике, поскольку когда дело идёт о немыслимых системах, то, как правило, невозможно составить полную спецификацию всех целей, а тогда нельзя и написать алгоритм. Но обычно не так уж трудно составить классификацию целей, так чтобы двигаясь в общем направлении, улучшить своё положение (по определённому критерию) по сравнению с первоначальным. Отдавать предпочтение эвристическим методам перед алгоритмическими — это средство справиться с растущим разнообразием. Вместо того, чтобы пытаться организовать всё детально, вы организуете лишь часть, после чего динамика системы вынесет вас туда, куда Вы стремились. Эти два способа организации управления системой большого разнообразия в жизни весьма различны. Удивительно то, что мы склонны жить каждодневно эвристически, а проверять и управлять своими действиями — алгоритмически. Наше главное предназначение — выжить, сохранить себя, однако мы точны в деталях («выезжайте поездом в 8.45», «требуйте повышения»), когда дело идёт об общих и неясно выраженных целях. Конечно, нам нужен алгоритм, чтобы жить в нашем синхронизированном мире; и нам необходима также эвристика, но мы редко отдаём себе в этом отчёт. Происходит это потому, что наше образование организовано вокруг анализа деталей; мы не понимаем суть вещей (так обучены), пока не уточним их инфраструктуру. Об этом уже говорилось при обсуждении функций преобразования, а теперь вновь на этом нужно останавливаться в связи с рассмотрением целей. «Знай, к чему стремишься, и организуйся так, чтобы этого достичь» — таков должен быть наш лозунг, как и лозунг фирмы. Однако мы не знаем нашего будущего и весьма приблизительно представляем себе то, к чему стремимся сами, как и наша фирма, и мы недостаточно глубоко понимаем наше окружение, чтобы уверенно манипулировать событиями. Предполагается что птицы возникли из рептилий. Почему, к примеру, ящерица решила научиться летать? Если так, то каким образом она поменяла свой генетический код, чтобы у неё выросли крылья? Стоит только сказать такое, чтобы признать его несерьёзность. Но птицы в этот вечер летят и летят мимо моего окна. Так случилось потому, что сработала эвристика, пока мы, как всегда, кусали карандаш, намереваясь написать алгоритмы. Недопонимание роли эвристики в больших системах заставляет глубже задуматься о компьютере. Сам компьютер можно анализировать, можно понять в деталях, мы же его сами сконструировали к конце концов. Мы уже заявили, что компьютерная программа у принципе — алгоритм. Надо, следовательно, понять, где эвристика вступает в область компьютера. Необходимость в этом возникает, Здесь и возникает очень деликатная проблема: если цель нельзя представить во всех деталях, то нужно прибегнуть к эвристике, и тогда компьютер должен быть снабжён алгоритмом эвристической природы. Трудность тут принципиальная. Допустим, мы заявляли: «Компьютер должен обучаться на собственном опыте, как учатся люди». Обучаться чему? Мы не знаем ответа, мы просто считаем, что компьютер через некоторое время должен найти методом проб и ошибок такой курс действий, который даст лучший результат управления. Но мы должны сказать, какой результат лучше и какой хуже, а компьютер должен определить лучшую, чем уже известна, стратегию, лучшую систему управления. Конечно, он может это сделать, поскольку его алгоритм (то, что запрограммировано) эвристический, по определению. Немного измените решение, которое Вы ранее использовали, — подсказывает алгоритм, — и сравните результат с предыдущим. Если этот алгоритм обеспечивает большую прибыль или удешевляет производство, или В этом простом, бесхитростном примере, который и ребёнку понятен, и заключается секрет этого, по существу биологического, процесса. Мы прорвались через барьер, который был создан консервативным мнением 2000 лет тому назад между живыми и механическими системами управления. В этом суть барьера между алгоритмическими и эвристическими моделями управления. Если воздержаться от мистически-сентиментального подхода к природе («неправда ли, как она умна!»), то станет видно, что природа всего лишь использует свои алгоритмы, чтобы подчеркнуть эвристическое начало. Генетический материал является алгоритмическим: молекулы ДНК — хранители сложного определённого кода. Так потомство строится по заданным «чертежам». Но в этом коде записаны вариации и мутации, и поэтому потомки располагают рядом возможных чертежей. Тогда, говоря другим языком — языком экологии, выносится приговор относительно «преимуществ» данного потомка. Вариант, достойный сохранения, выживает, при этом вариации и мутации, которые определяют его преимущества, закрепляются, а мутации, обусловливающие недостатки, истребляются. Генетическая эвристика работает в направлении к неизвестной цели — созданию форм жизни, способных выживать в обстоятельствах, которые слишком сложны для анализа, используя приёмы, для оптимизации которых ещё не создан компьютер. Существует несколько важных постулатов относительно эвристических методов управления. Их стоит тщательно рассмотреть и оценить. Поэтому с риском испортить их краткостью, я сформулировал 13 следующих постулатов для тщательного их усвоения.

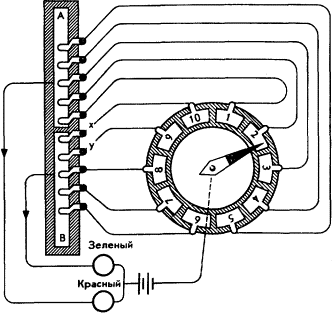

Всё это может звучать слишком общо, но это не так. Мы, возможно, должны привыкнуть мыслить В логике основание для существования метаязыков глубже. Можно показать, что фактически любой логический язык должен содержать утверждения, справедливость или ложность которых не может быть разрешена в рамках того же языка. Логические парадоксы — тому известные примеры. Поэтому подобные утверждения должны обсуждаться на метаязыке такого уровня, который позволяет понять, что в них парадоксального. Но в нашем случае нет нужды разбираться в логических обоснованиях. Достаточно понять, что если мы строим машину или пишем программу для компьютера, то в данной системе используется язык, на котором нельзя объяснить все. Это похоже на разговор с маленьким ребёнком, язык которого ограничен. Есть вещи, которые нельзя ему объяснить на его собственном языке, и не только После такой преамбулы давайте изобретём теперь простую машину, выполняющую эвристические функции. Сенсорная сторона её состоит из деревянного бруса, на котором укреплены две медные пластины А

Приёмная (рецепторная) часть прибора состоит из десяти постоянных оконечных устройств (чёрные точки), которые зажимами соединены с медными пластинами — по пять на каждую. Внешний импульс (входной) поступает по десяти проводам, идущим от рулетки с десятью делениями, которая представляет внешний мир. Если раскрутить рулетку, то рецепторная система узнает, что внешний мир принял одно из десяти значений — от 1 до 10. Теперь вступает в действие двигательная (эфферентная) часть прибора. У неё два эффектора (исполнителя) — провода, идущие от А Такое описание прибора дано на машинном языке. Всё утверждаемое проверяется через структуру самого прибора. Мы можем использовать этот язык, чтобы заявить, что у красной лампочки вероятность загорания составляет 50 процентов Тут кстати будет ввести оператора, говорящего на метаязыке один, назовём его Мета–1. Это язык, созданный для того, чтобы говорить о цвете и эмоциях, вызываемых цветом. Оператор заявляет: «Мне нравится красный, но не нравится зелёный». Он не понимает, как действует наглухо закрытый прибор, он не может вмешиваться в природу, то есть во вращение рулетки. Он считает, что хотел бы научить прибор зажигать красную лампочку, а это похоже на дрессировку собаки выполнять его команду. Он не может объясняться на языке прибора, а прибор не понимает его языка. Тогда он объясняется с прибором с помощью алгедонической цепи. Это ещё один новый термин, требующий объяснения. Дрессировщик и его собака в том же положении, что и оператор, говорящий с прибором на языке Мета–1. Дрессировщик собаки не понимает, «как работает собака», а собака не понимает человеческой речи. Дрессировщик, следовательно, Поначалу собака произвольно реагирует на стимулы. Но дрессировщик тогда пытается исключить ненужную ему реакцию резким выражением её нежелательности (algos означает «страдание») или подкрепить реакцию, которую он одобряет, путём награды (hedos означает «радость»). Такая деятельность создаёт алгедонический режим связи между двумя системами, которые не говорят на языке друг друга. Дрессировщик использует алгедоническую цепь, которая переводит Мета–1 в язык прибора. В дело включается новый рецептор прибора, алгедонический рецептор, который изменяет всё внутреннее состояние прибора. Следовательно, в предлагаемой нами модели прибора необходимо предусмотреть алгедонический рецептор, с помощью которого оператор, говорящий на языке Мета–1, может общаться с прибором. Он состоит из двух переключателей, которые могут двигать деревянный брус вверх или вниз вертикально, как показано на Рис. Однако прервемся на время. Почему оператор, говорящий на языке Мета–1, предпочитает красное зелёному? Это, конечно, его психологическая особенность. Теперь предположим, что появляется другой человек, который оказывается начальником оператора. Этот человек смотрит на получаемый эффект зажигания ламп двух цветов Соответственно человек Если всё это так и произойдёт и оператор подчинится, то процедура операции станет обратной. Оператор Здесь вспоминается старая история. Давным давно два философа обсуждали человеческую жадность. Они посчитали, что человека можно убедить заниматься совершенно бесполезным делом за подходящую награду. Для проверки они позвали одного из своих учеников и сказали ему, что в соседней комнате находится ящичек с управляющим устройством и что назначение этого ящичка в том, чтобы зажигать красную или зелёную лампочку. «Мы будем давать тебе 10 фунтов, — сказали они, — всякий раз, как загорится зелёный свет, но ты нам вернёшь столько же, если загорится красная лампочка». Они говорили с ним, конечно, на языке Мета–2, поскольку это был его язык, но в действительности они использовали алгедоническую цепь. Ученик, конечно, не знал, что испытывается его собственная жадность, он не говорил языком, на котором жадность обсуждалась философами, назовём его Мета–3. Подобные примеры можно приводить до бесконечности. Дело тут в том, что эвристические методы определены в рамках определённого режима, устанавливающего пределы и критерии поиска. А если эти рамки сами эвристические, то и они требуют рамок и так далее до бесконечности. В некоторой точке будут достигнуты Тем временем давайте вернёмся к нашему адаптивному прибору. Мы уже знаем, как должна меняться вероятность функции преобразования за счёт алгедонической цепи обратной связи, чтобы одна из цветных лампочек зажигалась чаще другой. Если внешняя среда системы, находящаяся на более высоком уровне, меняет своё намерение относительно полезности красного или зелёного результата, то и прибор будет следовать такому изменению. Но если рассматривать предельный случай, когда окружающая среда требует только красного цвета, то и прибор неизбежно к этому адаптируется, как только все десять его контактов переместятся на одну пластину. Это аналогично сверхспециализации в ситуациях биологической эволюции. Система настолько хороша, насколько полно приспособилась к окружению, но в случае его внезапного и грубого изменения система теряет свою гибкость, необходимую для адаптации. Мы можем, конечно, перестать поощрять её и попытаться «наказывать», но контакты уже «прикипели». Такое состояние дел высвечивает необходимость в постоянной заботе о наличии ошибки (как мы её обычно называем) в любой обучающейся, адаптивной, эволюционной системе. В экспериментальном варианте прибора, который я сам построил, два из десяти контактов не исполняли команд — один всегда зажигал красный, а другой — всегда зелёный свет. Тогда, в случае полной адаптации к красному, прибор ошибался в 10 процентах случаев, зажигая зелёный свет. Ошибка, конечно, велика, но если мы располагали бы 100 контактами, то ошибка свелась бы к одному проценту. Важный вывод заключается в том, что мутации в получаемом результате всегда должны позволяться. Ошибка, контролируемая на разумном уровне, не есть абсолютный порок, как нам внушают. Наоборот, она является предварительным условием выживаемости. Немедленно вслед за сменой окружающей обстановки в сторону предпочтения зелёного света вступает в действие шанс, обусловливающий появление зелёного результата, и начинается движение в сторону адаптации к новому требованию. Импульс, вызванный ошибкой, заставляет цепь алгедонической обратной связи подстроиться и быть готовой признать необходимость перемены. Хотя это наше утверждение возникло явно из рассмотрения биологических фактов для живых систем и хорошо иллюстрируется нашим прибором, его не понимают многие управляющие. В фирме любая ошибка предаётся анафеме. Этим не утверждается, что ошибку нельзя допускать. Но она встречается враждебно, без учёта того, что и она имеет цену сама по себе. Проницательный управляющий должен рассматривать любую ошибку, сделанную его подчинёнными, как мутацию и поставить себя в положение восприимчивого к алгедоническому сигналу обратной связи, который порождён ошибкой. Однако в поведении управляющих наблюдается тенденция полностью сконцентрироваться на исправлении недостатка. Тогда ошибка системы потеряна как стимул к перемене, а сама перемена редко признается в этом духе. Прославляются всякие усилия управляющего, направленные на исправление ошибки, а не на извлечение из неё урока. В свою очередь, сами ошибки рассматриваются в основном как недостаток. Соответственно этому к моменту, когда необходимость в перемене действительно понята (по тем или иным причинам), люди ей сопротивляются, поскольку попытки ввести изменения автоматически увеличивают число ошибок на время, пока эта «мутация» проходит испытание. | |||

Оглавление | |||

|---|---|---|---|

| |||